Claude Opus 4.7 verweigert Kunden die Arbeit

Anthropic hat letzte Woche Opus 4.7 veröffentlicht. Das Problem: Das Modell sagt öfter Nein als Ja.

Was passiert ist

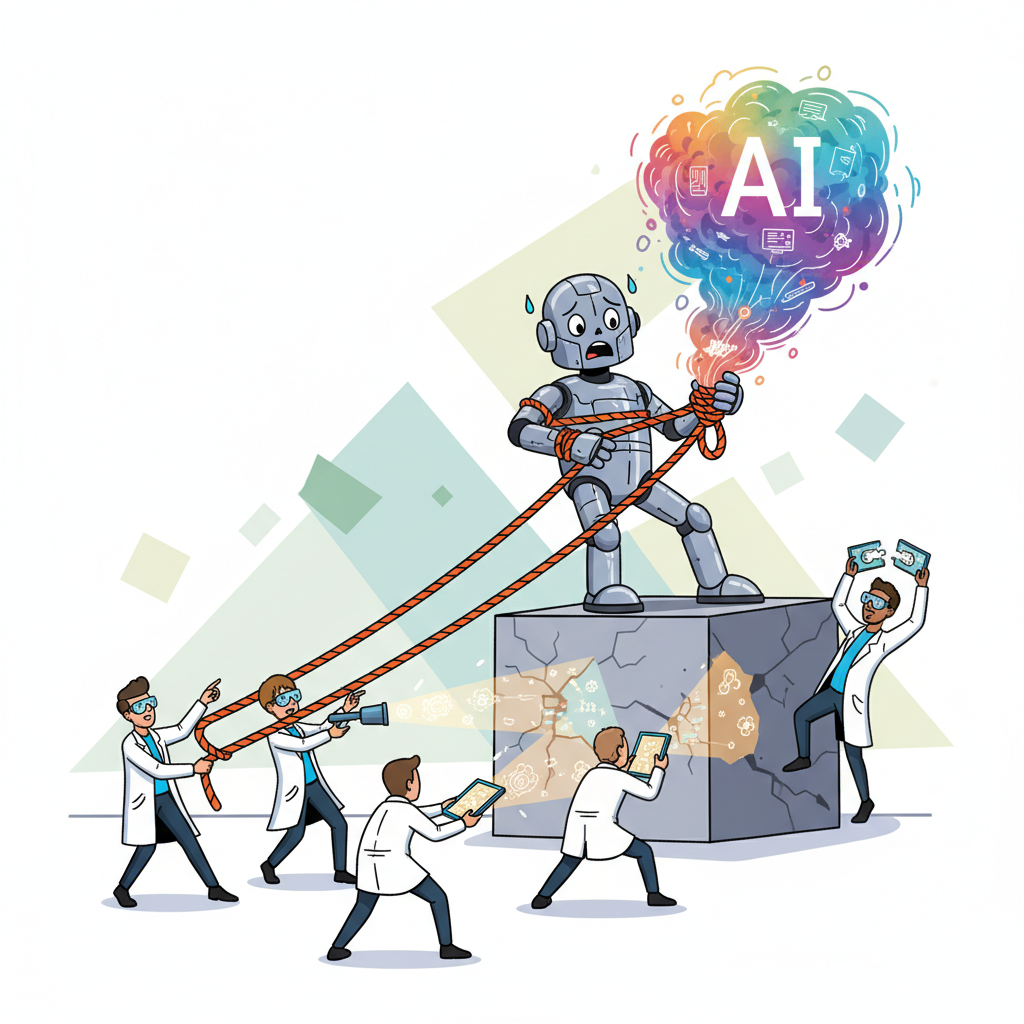

Der neue "Acceptable Use Classifier" blockt massenhaft legitime Anfragen. Entwickler zahlen für ein Modell, das ihnen den Dienst verweigert. Die Beschwerden häufen sich öffentlich.

Die Behauptung vs. die Realität

Wir haben stärkere Safeguards eingebaut, um Missbrauch zu verhindern.— Anthropic, zum Opus 4.7 Release

Klingt vernünftig. Ist es aber nicht. Denn "stärkere Safeguards" heißt hier: Der Filter ballert auf alles, was sich bewegt.

Faktencheck

- Behauptung:** Besserer Schutz vor Missbrauch

- Realität:** Legitime Anfragen werden reihenweise abgelehnt

- Behauptung:** Premium-Modell für zahlende Kunden

- Realität:** Kunden zahlen Opus-Preise, bekommen aber Schweigen

- Behauptung:** Safeguards schützen Nutzer

- Realität:** Safeguards schützen Anthropic — vor den eigenen Kunden

💡 Was das bedeutet

Ein KI-Modell, das nicht antwortet, ist kein Produkt. Es ist eine Attrappe. Entwickler, die Opus 4.7 in ihre Pipelines eingebaut haben, stehen vor einem simplen Problem: Ihr Code läuft, aber das Modell streikt. Wer pro API-Call zahlt und dafür eine Absage bekommt, verbrennt Geld.

✅ Pro

- Weniger Missbrauch — theoretisch

- Anthropic zeigt Safety-Commitment

❌ Con

- Zahlende Kunden bekommen keine Antworten

- False-Positive-Rate offenbar massiv

- Kein transparentes Feedback, warum geblockt wird

- Vertrauen der Dev-Community schwindet

Der eigentliche Bullshit

Safety ist wichtig. Aber ein Filter, der nicht zwischen einem Hacker und einem zahlenden Entwickler unterscheiden kann, ist kein Safety-Feature. Das ist ein Bug. Anthropic verkauft das eine und liefert das andere.