Googles Gemma 4 zerlegt Modelle dreimal seiner Größe

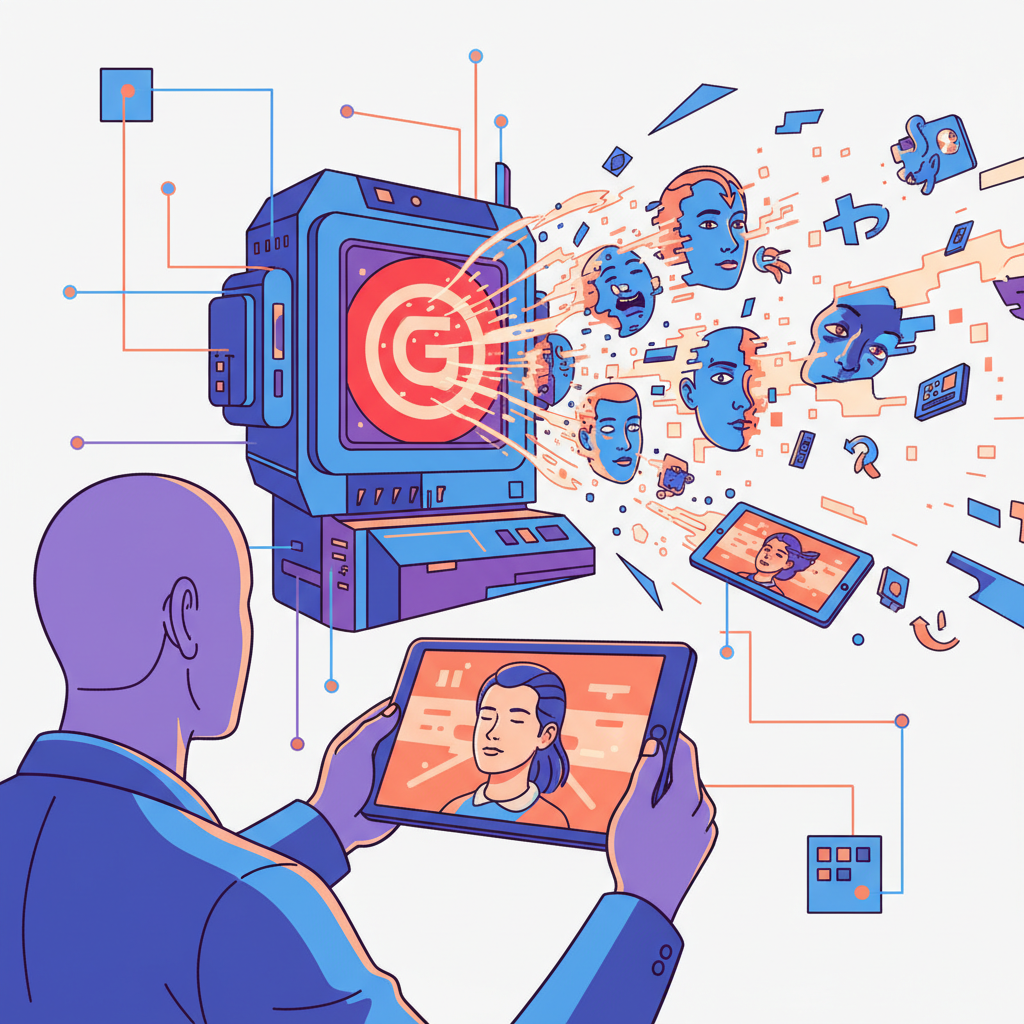

Google DeepMind knallt Gemma 4 auf den Tisch — und die Open-Source-Welt horcht auf. Das 31B-Modell hält mit Riesen wie Kimi K2.5 (744B Parameter) und GLM-5 (1 Billion Parameter) mit. Wohlgemerkt: mit einem Bruchteil der Parameter.

Warum das jetzt kommt

Die Timing ist kein Zufall. Das Allen Institute verliert gerade reihenweise Leute, GPT-OSS von OpenAI hängt in der Schwebe. Die Zukunft amerikanischer Open-Source-Modelle? Unklar. Google springt in die Lücke.

Zahlenbox

- 31B** — Parameter der dichten Gemma-4-Variante

- 744B** — Parameter von Kimi K2.5, das Gemma 4 matcht

- 1T** — Parameter von GLM-5, ebenfalls gleichauf

- ~24×** — weniger Parameter als die Konkurrenz bei gleicher Leistung

David gegen gleich zwei Goliaths

⚖️ Gemma 4 (31B) vs. Konkurrenz

- Modellgröße:** 31B vs. 744B (Kimi) vs. 1T (GLM-5)

- Architektur:** Dense — kein Mixture-of-Experts-Trick

- Multimodal:** Ja — Text, Bild, mehrere Modalitäten

- Benchmark-Ranking:** Gleichauf an der Spitze der Open Models

- Effizienz:** Drastisch besser pro Parameter

💡 Was das bedeutet

Google beweist: Brute-Force-Skalierung ist nicht alles. Ein clever gebautes 31B-Modell schlägt aufgeblähte Billionen-Parameter-Monster. Für Entwickler heißt das: Top-Performance auf Hardware, die man sich tatsächlich leisten kann. Und für die Open-Source-Community: Der wichtigste Player liefert weiter — genau dann, wenn andere schwächeln.

✅ Pro

- Konkurrenzfähig mit den besten offenen Modellen weltweit

- Dramatisch weniger Ressourcen nötig

- Multimodal out of the box

- Google liefert verlässlich Updates

❌ Con

- Dense-Architektur bei 31B ist trotzdem nicht klein

- Google kann Lizenz jederzeit einschränken

- Gemma 3 war erst vor Kurzem erschienen — Ökosystem-Fragmentierung