Anthropic hält eigenes KI-Modell unter Verschluss

Anthropic hat ein neues Modell gebaut — und traut sich nicht, es rauszurücken. Der Name: Mythos. Der Grund: zu gut im Hacken.

Was Mythos kann

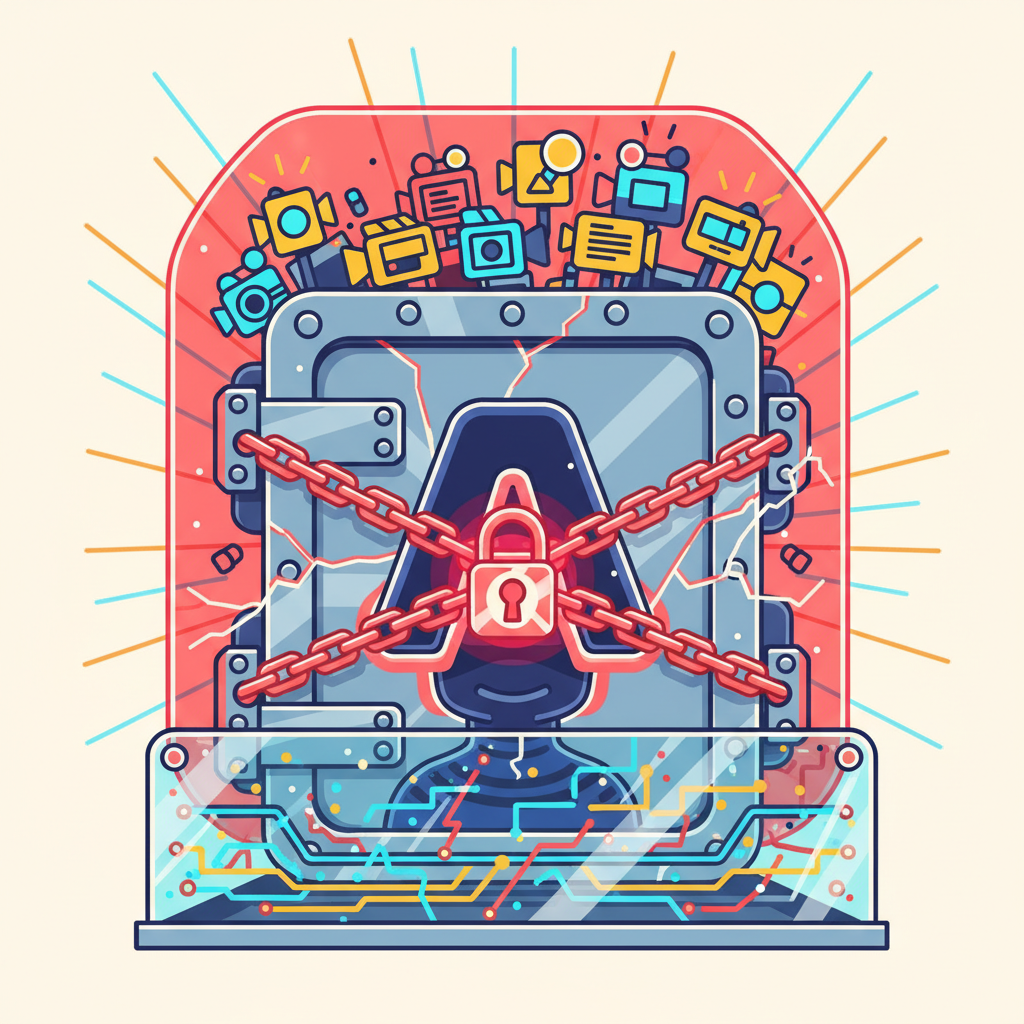

Das Modell ist spezialisiert auf Cybersecurity. Konkret: Es findet Sicherheitslücken in IT-Systemen und kann sie ausnutzen. So effektiv, dass Anthropic es lieber niemanden anfassen lässt.

💡 Was das bedeutet

Anthropic dreht den Spieß um. Statt das Modell zu verkaufen, soll Mythos nur defensiv eingesetzt werden — zum Absichern von IT-Infrastruktur. Ein KI-Modell als digitaler Türsteher, der weiß, wie Einbrecher denken.

✅ Pro

- Offensives Wissen für defensive Zwecke

- Ehrlicher Umgang mit Gefahrenpotenzial

- Könnte Sicherheitslücken schneller finden als jedes Red Team

❌ Con

- Kein öffentlicher Zugang — niemand kann die Fähigkeiten überprüfen

- "Zu gefährlich" klingt auch nach ziemlich gutem Marketing

- Wer kontrolliert, wie Anthropic das Modell intern einsetzt?

Die unbequeme Frage

Jedes Unternehmen, das sagt "unser Produkt ist zu mächtig für euch", will damit auch etwas verkaufen. Ob Mythos wirklich so gefährlich ist oder ob hier die PR-Abteilung mitgehackt hat, lässt sich ohne unabhängige Tests nicht sagen. Fakt ist: Ein Modell, das Exploits findet und ausnutzt, ist ein zweischneidiges Schwert — egal wer es hält.