Alibabas neues Modell sieht, hört und codet

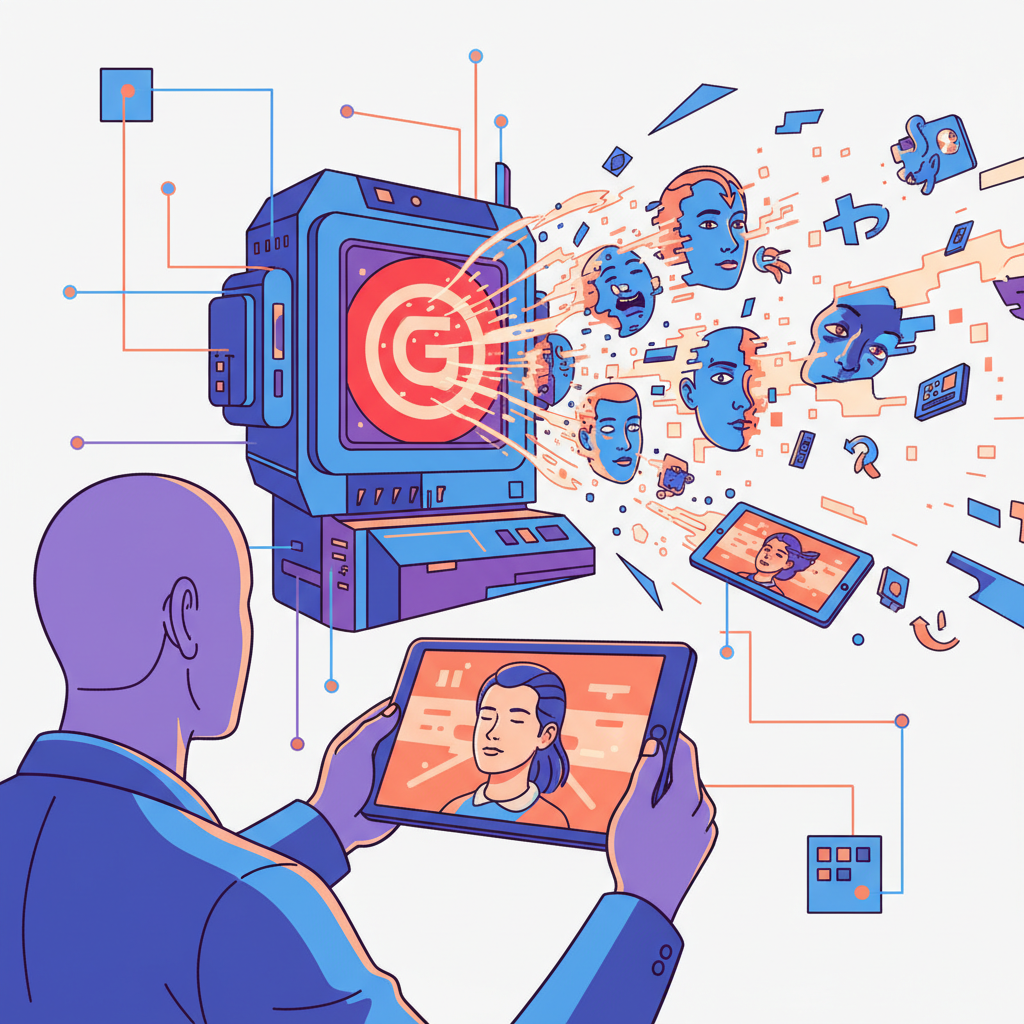

Alibaba hat Qwen3.5-Omni veröffentlicht — ein KI-Modell, das Text, Bilder, Audio und Video gleichzeitig verarbeitet. Und ja, es soll besser sein als Googles Gemini.

Was Qwen3.5-Omni kann

- Text:** Lesen, verstehen, generieren

- Bilder:** Erkennen und analysieren

- Audio:** Verstehen und erzeugen

- Video:** Inhalte interpretieren

- Neu:** Programmieren per Sprachbefehl und Videoinput

Das ist kein Spielzeug. Wer einem Modell ein Video zeigen und per Sprache sagen kann "Bau mir das nach" — der braucht bald keinen Junior-Entwickler mehr.

Zahlenbox

- Modalitäten:** 4 gleichzeitig (Text, Bild, Audio, Video)

- Benchmark:** Übertrifft Gemini 3.1 Pro bei Audio-Aufgaben

- Herkunft:** Alibaba Cloud / Qwen-Team

- Zugang:** Open Weight

💡 Was das bedeutet

Alibaba prescht vor. Während OpenAI und Google ihre omnimodalen Fähigkeiten häppchenweise ausrollen, liefert das Qwen-Team ein Komplettpaket — und gibt es als Open-Weight-Modell raus. Für Entwickler in Europa heißt das: Eine echte Alternative zu den US-Modellen, die man selbst hosten kann.

Coden per Sprache — ernst gemeint?

Die interessanteste Neuerung: Du zeigst dem Modell ein Video, redest dazu, und es schreibt Code. Klingt nach Demo-Magie. Aber wenn die Benchmarks stimmen, ist das ein konkreter Workflow-Vorteil gegenüber Gemini und GPT-4o.