Alibaba wirft Qwen3.5-Omni gegen Gemini ins Rennen

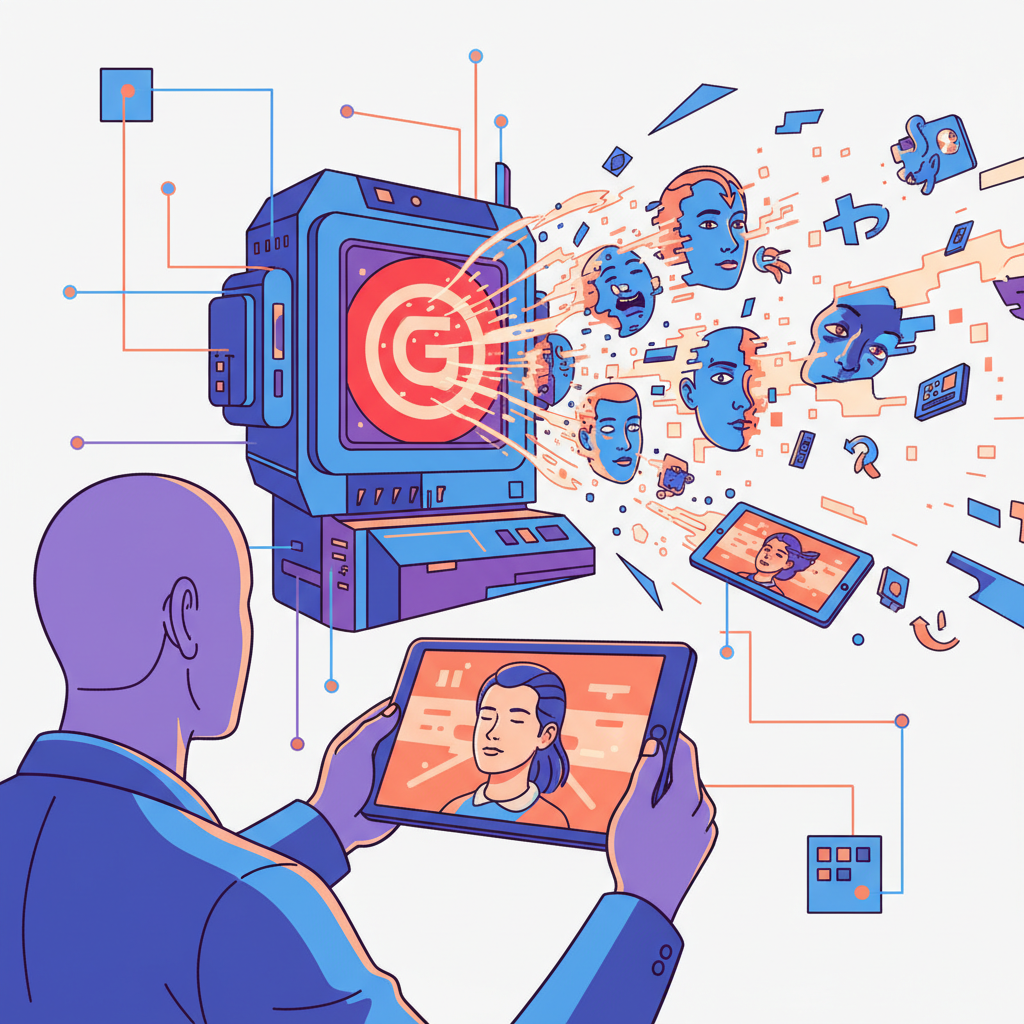

Alibaba hat nachgelegt. Das Qwen-Team veröffentlicht Qwen3.5-Omni — ein Modell, das Text, Bild, Audio und Video nativ verarbeitet. Kein Zusammenkleben einzelner Module mehr, sondern eine einzige End-to-End-Architektur.

Was steckt drin

Bisherige Multimodal-Modelle funktionierten wie Frankenstein: Ein Text-Modell als Basis, dazu separate Encoder für Vision und Audio draufgeschraubt. Qwen3.5-Omni macht Schluss damit. Alles läuft durch eine einheitliche Architektur — nativ omnimodal, nicht nachträglich zusammengeflickt.

💡 Was das bedeutet

Das Modell zielt direkt auf Googles Gemini 3.1 Pro. Alibaba will bei Echtzeit-Interaktion mitspielen: Text rein, Audio raus, Video analysieren — alles in einem Durchlauf. Für Entwickler heißt das: eine API statt drei, ein Modell statt einer Pipeline.

⚖️ Vergleich: Wrapper vs. Nativ

- Alte Architektur:** Separate Encoder für jede Modalität, zusammengeklebt mit einem Text-Backbone

- Qwen3.5-Omni:** Ein Modell, das alle Modalitäten von Grund auf versteht

- Vorteil nativ:** Weniger Latenz, besseres Cross-Modal-Verständnis

- Risiko:** Benchmarks fehlen noch — Alibaba liefert bisher mehr Versprechen als Zahlen

Der Kontext

Google hat mit Gemini vorgelegt. OpenAI hat GPT-4o. Meta baut an eigenen Omnimodal-Modellen. Alibaba will beweisen, dass China bei nativer Multimodalität nicht nur mitspielt, sondern mitbestimmt. Qwen war bisher stark bei Text und Code — jetzt kommt der Sprung auf alle Sinne.

- Modalitäten:** Text, Bild, Audio, Video

- Echtzeit:** Ja, Realtime-Interaktion angekündigt

- Architektur:** End-to-End, kein Wrapper-Ansatz

- Zielgruppe:** Entwickler, die ein einziges Modell für alles wollen