Alibaba greift Gemini mit Omni-Modell an

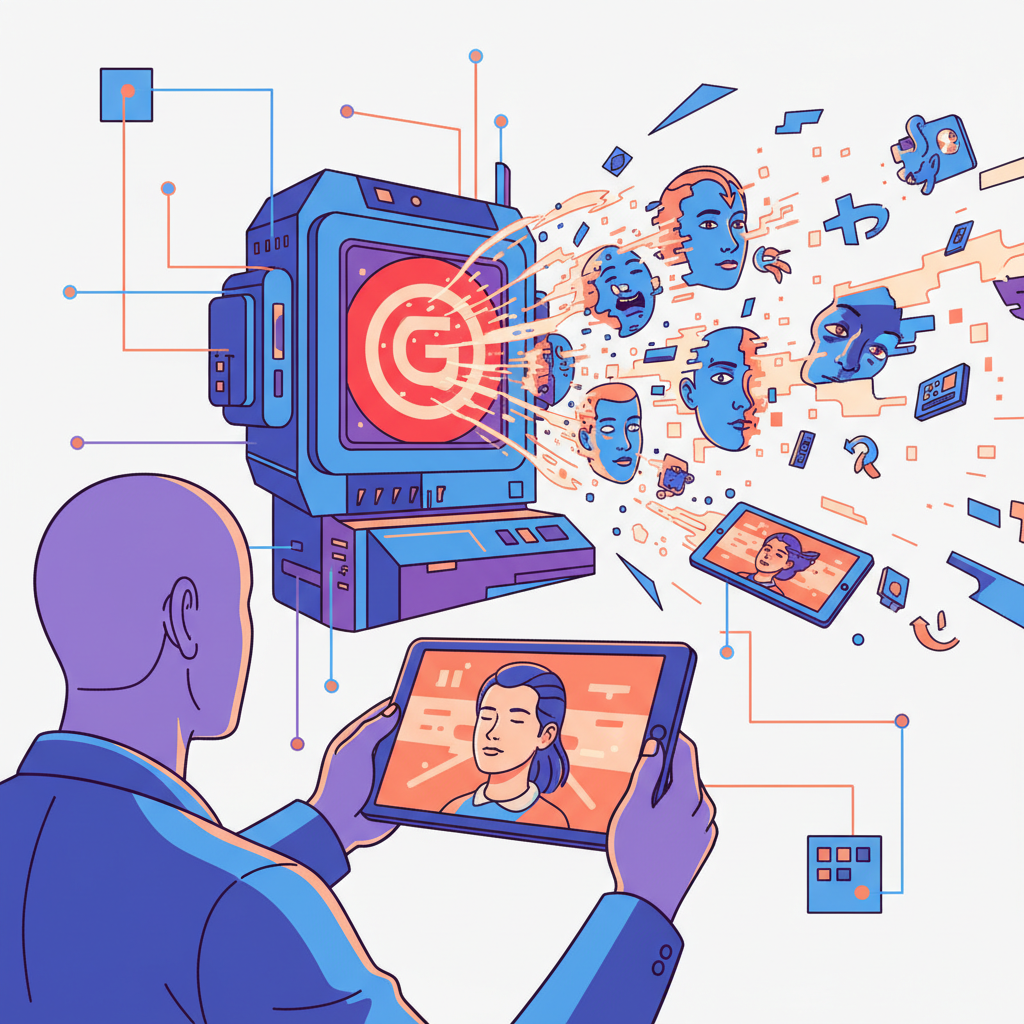

Qwen liefert. Alibabas KI-Team hat Qwen3.5-Omni veröffentlicht — ein natives Multimodal-Modell, das Text, Bilder, Audio und Video in einer einzigen Architektur verarbeitet. Kein zusammengeklebter Flickenteppich, sondern End-to-End.

Was Qwen3.5-Omni anders macht

Bisher funktionierten die meisten Multimodal-Modelle nach dem Wrapper-Prinzip: Ein Text-Backbone, daran angeflanscht separate Encoder für Bild und Ton. Qwen3.5-Omni bricht damit. Das Modell verarbeitet alle Modalitäten nativ in einem einheitlichen Framework — inklusive Realtime-Interaktion.

⚖️ Qwen3.5-Omni vs. Wrapper-Modelle

- Architektur:** Nativ omnimodal statt modularer Anbau

- Input:** Text, Bild, Audio, Video — alles gleichzeitig

- Interaktion:** Realtime-fähig, nicht nur Batch-Processing

- Zielgruppe:** Direkter Angriff auf Gemini 3.1 Pro

Warum das Timing zählt

📅 Timeline

- 2024:** GPT-4o bringt Multimodalität in den Mainstream

- 2025:** Gemini 2.0 und Claude setzen neue Standards

- 2026:** Qwen3.5-Omni will auf Augenhöhe mitspielen

Alibaba positioniert sich damit als ernsthafter Player im Omni-Rennen. China liefert nicht mehr nur Billig-Klone, sondern architektonische Eigenentwicklungen.

💡 Was das bedeutet

Der Markt für native Multimodal-Modelle wird enger. Wer Text, Bild, Audio und Video nicht aus einem Guss beherrscht, fliegt raus. Alibaba zwingt Google und OpenAI, schneller zu liefern — und drückt gleichzeitig die Preise nach unten. Für Entwickler heißt das: mehr Auswahl, mehr Druck auf die APIs.